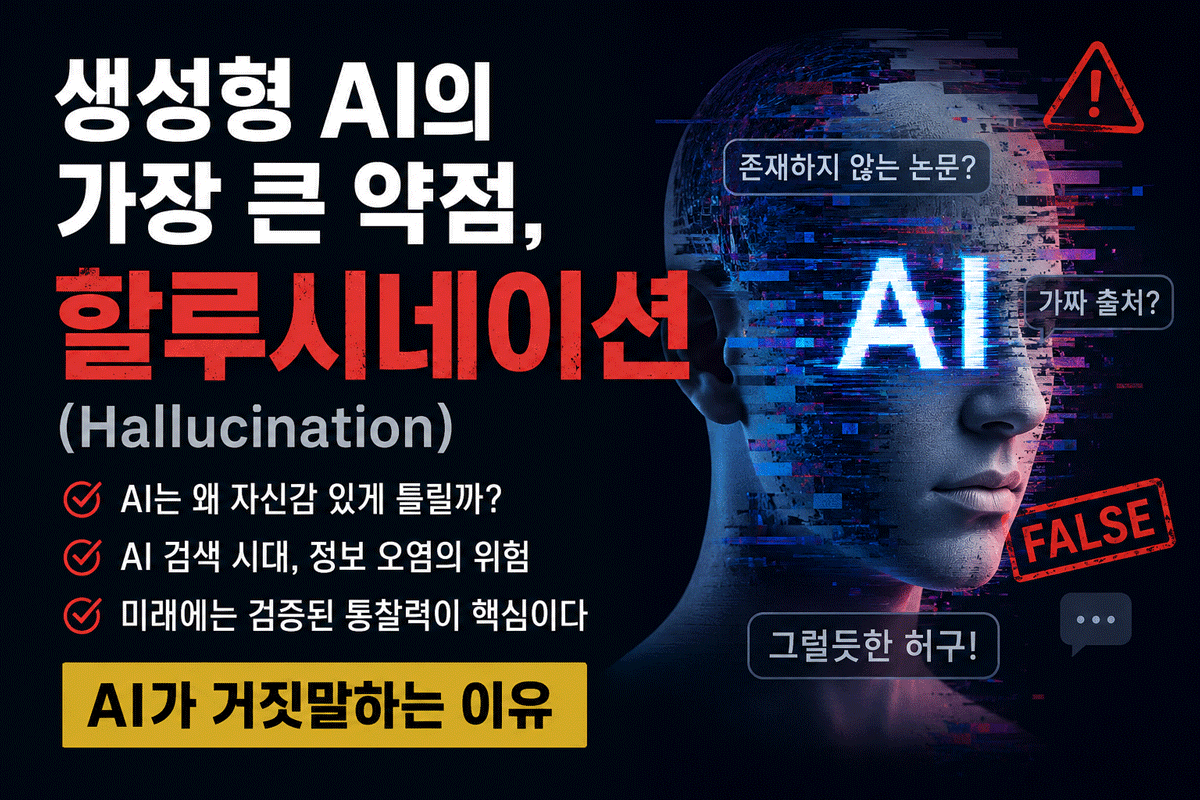

생성형 AI의 가장 큰 약점, 할루시네이션(Hallucination)

생성형 AI는 이제 검색과 업무의 표준이 되고 있다.하지만 이 편리함 뒤에는 사용자의 판단력을 흐리게 만드는 치명적인 결함이 존재한다. 바로 할루시네이션(Hallucination)이다. 할루시네이션은 왜 생기는가: 확률론적 언어 모델의 한계 많은 이들이 인공지능을 ‘백과사전’처럼 여기지만, 사실 LLM은 본질적으로 ‘진실을 탐구하는 지능’이 아니다. 그 정체는 ‘다음에 올 확률이 가장 높은 단어를 기막히게 찾아내는 예측 엔진’에 불과하다. 여기서 할루시네이션은 시스템의 … 더 읽기